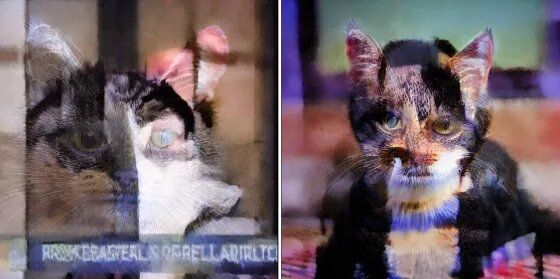

Художники "засліплюють" ШІ котами, щоб захистити свої роботи від крадіжки

Інструмент Nightshade змінює зображення незначними способами

Художники та комп'ютерні науковці тестують новий спосіб, як запобігти крадіжці авторських прав штучним інтелектом. Вони засліплюють моделі ШІ зображенням котів. Їх накладають на оригінальні зображення так, аби це не було помітно людському оку.

Як пише NBCnews, інструмент під назвою Nightshade, випущений у січні дослідниками Чиказького університету, змінює зображення незначним чином, що є майже непомітним для людського ока, але кардинально відрізняється для платформ ШІ, які обробляють фото. Тепер художники, такі як Карла Ортіс, використовують Nightshade для захисту своїх творів від сканування та копіювання програмами для перетворення тексту в зображення, такими як DreamUp від DeviantArt, Stable Diffusion від Stability AI та іншими.

“Мене вразило те, що значна їх частина – це по суті вся моя робота, вся робота моїх колег, майже всі роботи художників, яких я знаю. І все це було зроблено без чиєїсь згоди – без визнання, без компенсації, без взагалі нічого”, – сказала Ортіс, концепт-художниця та ілюстраторка, чиє портфоліо дозволило їй отримати роботу з розробки візуальних ефектів для фільмів, телебачення та відеоігор, таких як “Зоряні війни”, “Чорна пантера” та Final Fantasy XVI.

Nightshade використовує той факт, що моделі ШІ бачать світ не так, як люди, – зазначив керівник досліджень Шон Шен.

“Машини, вони бачать лише великий масив чисел, правда? Це значення пікселів від нуля до 255, і для моделі це все, що вона сприймає. Таким чином, Nightshade змінює тисячі пікселів – це крапля в морі для стандартних зображень, що містять мільйони пікселів, але достатня, щоб обдурити модель і змусити її побачити щось зовсім інше", – пояснив Шен, аспірант в Чиказькому університеті.

У статті, яка буде представлена у травні, команда описує, як Nightshade автоматично обирає concept, яким вона має намір заплутати програму ШІ, що реагує на певний запит – наприклад, вбудовуючи спотворення пікселів у фотографії “собак”, які сприймаються моделлю як “кішка”. Після того, як 1000 ледь помітно “отруєних” фотографій собак подали на вхід текстово-графічному інструменту ШІ та запитали зображення собаки, модель генерує щось абсолютно не схоже на собаку.

Хоча спотворення Nightshade не завжди перетворюються на котячі, програма вирішує в кожному конкретному випадку, яке альтернативне поняття вона хоче, щоб його "побачив" ШІ. За словами Шена, у деяких випадках потрібно лише 30 "засліплених" фотографій, щоб таким чином отруїти модель.

Бен Жао, професор комп'ютерних наук, який очолює лабораторію Чиказького університету, що розробила Nightshade, не очікує масового прийняття цього інструменту на рівні, який міг би загрожувати знищенням генераторів зображень на основі ШІ. Натомість він описав його як "спис", який може зробити деякі вужчі застосування настільки непридатними, що змусить компанії платити, коли вони копіюють роботи художників.

"Якщо ви є творцем будь-якого типу, наприклад, робите фотографії, і ви не обов'язково хочете, щоб ваші фотографії використовувались для навчання моделі – або щоб подібність ваших дітей чи ваша власна подібність потрапляли в модель – тоді Nightshade – це те, що ви можете розглянути", – сказав Жао.

Інструмент безкоштовний для використання. Жао сказав, що має намір залишити його таким.

Моделі, такі як Stable Diffusion, вже пропонують можливість "відмовитися", щоб художники могли попередити не використовувати їхній контент, а представник Stability AI зазначив, що вони були однією з перших компаній, які взяли участь у реєстрі "не навчати". Але багато власників авторських прав скаржаться, що поширення інструментів ШІ випереджає їхні зусилля щодо захисту своєї роботи.

Дискусія щодо захисту інтелектуальної власності доповнює ширший спектр етичних проблем щодо ШІ, включаючи поширеність діпфейків та питання щодо меж використання водяних знаків для стримування цих та інших зловживань. Хоча в галузі ШІ зростає визнання того, що потрібні додаткові запобіжні заходи, швидкий розвиток технологій – включаючи новіші інструменти для перетворення тексту на відео, такі як Sora від OpenAI – турбує деяких експертів.

"Я не знаю, чи це багато дасть, тому що буде технологічне рішення, яке стане контрзаходом до такої атаки", – сказала про Nightshade Соня Шмер-Галундер, професорка ШІ та етики в Університеті Флориди.

Дослідники Чиказького університету визнають імовірність появи "потенційних захисних механізмів" проти засліплення зображень Nightshade, оскільки платформи ШІ оновлюються, щоб відфільтровувати дані та зображення, які підозрюються у проходженні "ненормальних змін".

Жао вважає несправедливим покладати тягар на окремих осіб, щоб відганяти моделі ШІ від своїх зображень.

"До скількох компаній вам потрібно звертатися особисто, щоб сказати їм не порушувати ваші права?" – сказав він.

Тим часом, Ортіс вважає Nightshade корисною "атакою", яка надає її роботі певного захисту, поки вона шукає більш дієвих методів у суді.

"Nightshade просто каже: "Гей, якщо ви візьмете це без моєї згоди, можуть бути наслідки", – сказала Ортіс, яка входить до складу колективного позову, поданого проти Stability AI, Midjourney та DeviantArt у січні 2023 року щодо порушення авторських прав.

Суд наприкінці минулого року відхилив деякі аргументи позивачів, але залишив їм можливість подати виправлену позовну заяву, що вони й зробили у листопаді, додавши як відповідача Runway AI. У клопотанні про відхилення позову на початку цього року Stability AI стверджувала, що "просте наслідування художнього стилю не є порушенням авторських прав на будь-яку роботу". Stability AI відмовилася коментувати судовий процес. Midjourney, DeviantArt і Runway AI не відповіли на запити щодо коментарів.

Оксфордський університет розробив ШІ-помічника для лікарів: DrugGPT

Вчені Оксфордського університету представили інноваційний інструмент під назвою DrugGPT, який покликаний допомогти лікарям уникнути помилок при призначенні ліків. Цей ШІ-помічник, розроблений як "помічник лікаря", буде надавати медикам альтернативні варіанти лікування на основі введеної інформації про стан пацієнта.

DrugGPT функціонує за допомогою чат-бота, куди лікар вводить дані про пацієнта. На основі цих даних ШІ аналізує доступні варіанти лікування та пропонує оптимальні рекомендації. Ці рекомендації можуть включати дослідження, блок-схеми та посилання на додаткові ресурси.

Нагадаємо, раніше Інформатор писав, що ChatGPT можна користуватися без реєстрації. Наразі ця послуга доступна не у всіх країнах. Проте українські користувачі вже можуть спробувати.

Підписуйтесь на наш Telegram-канал, щоб не пропустити важливих новин. Підписатися на канал у Viber можна тут.